在本文中,你将学习:

- 什么是 Azure Logic Apps,以及它能提供什么。

- 为什么在 Azure Logic Apps 中集成 Bright Data 的 SERP API 是一种制胜策略。

- 如何构建一个连接到 Bright Data 的 SERP API 的 Azure Logic App 工作流。

我们开始吧!

什么是 Azure Logic Apps?

Azure Logic Apps 是一个基于云的集成平台,用于以少量或零代码创建并运行自动化工作流。它提供可视化设计器,以及 1400+ 预构建连接器,帮助你在云端与本地环境中连接各类服务、系统、应用与数据源。

它的主要目标是帮助你自动化业务流程并集成分散的系统。这通过低代码/无代码的拖拽式工作流构建器、事件触发器,以及覆盖 Gmail、Office 365、Salesforce、SAP、SQL 与 Azure 等服务的大规模连接器生态来实现。

Azure Logic Apps vs Azure AI Foundry:有什么区别?

如果你已经读过我们关于 在 Azure AI Foundry 中集成 SERP API 的指南,你可能会好奇 Logic Apps 有何不同。这两者服务于完全不同的目的:

- Azure AI Foundry 是一个统一的 AI 开发平台,专注于构建、部署与管理 AI 应用、智能体与提示词流(prompt flows)。它提供对 LLM 目录的访问(来自 Azure OpenAI、Meta、Mistral 等),面向以 AI 为先的开发场景,包括提示词工程、模型微调与 RAG 工作流。

- Azure Logic Apps 是一个工作流自动化与集成平台,专注于连接系统、自动化业务流程,并在数百种服务之间编排任务。它擅长事件驱动的自动化、数据转发与 API 集成,且无需编写代码。

简而言之,Azure AI Foundry 用于构建 AI 驱动的应用与提示词流;而 Azure Logic Apps 用于构建连接系统的自动化、事件驱动的业务工作流。

它们实际上是完美互补的。Azure Logic Apps 可以作为 Azure AI Foundry 智能体的 Action,你也可以从 AI 智能体触发 Logic Apps 工作流。在本教程中,你将看到 Logic Apps 单独如何与 Bright Data 的 SERP API 集成,从而在不编写一行 Python、也不部署任何 LLM 的情况下,构建强大的自动化网页搜索工作流。

为什么要在 Azure Logic Apps 中集成 Bright Data 的 SERP API

Azure Logic Apps 提供强大的 HTTP 连接器,可让你调用任何 REST API。这为将工作流与外部数据源连接打开了大门。不过,如果你想把实时网页搜索数据注入到自动化工作流中,你需要一个可靠、可扩展、且结构化的数据源。

这就是 Bright Data 的多引擎搜索结果 API发挥作用的地方。SERP API 让你能够以编程方式在搜索引擎上发起查询(包括 Google、Bing、DuckDuckGo、Yandex 等),并获取完整的 SERP 内容。它以多种格式返回数据,包括解析后的 JSON、原始 HTML,以及面向 AI 的 Markdown,从而为你提供可靠、最新且可验证的数据来源。

这种方法尤其适用于:

- 自动化监测工作流:追踪与你的品牌、竞争对手或行业主题相关的新闻,并发送邮件提醒。

- 线索生成流水线:搜索特定企业列表,并将结果路由到你的 CRM。

- 内容策展系统:获取某个主题的热门文章,并存入 SharePoint 或数据库。

- 价格与商品监控:定期检查搜索结果中的价格数据,并在变化时触发告警。

将 Azure Logic Apps 的无代码自动化能力与 Bright Data 面向 AI 智能体的 Web 访问基础设施结合后,你可以创建能够对实时 Web 数据做出响应的工作流,而无需维护任何抓取基础设施。

如何在 Azure Logic App 中通过 SERP API 获取网页搜索上下文

在本节的引导式步骤中,你将看到如何将 Bright Data 的 SERP API 集成到 Azure Logic App 工作流中,作为新闻监测与告警系统的一部分。该工作流由四个主要步骤组成:

- 定时触发器:工作流按周期计划运行(例如每天)。

- 拉取新闻:HTTP 操作调用 Bright Data 的 SERP API,从 Google 获取某个预设主题的新闻文章。

- 解析响应:Parse JSON 操作将 SERP 结果结构化,便于后续处理。

- 告警投递:“For each” 循环遍历结果,并通过 Gmail 连接器为每条头部新闻发送一封邮件。

注意:这只是一个示例,你还可以在许多其他场景与用例中使用 SERP API。例如,你也可以构建由 SERP 数据驱动的 RAG 聊天机器人,或构建品牌声誉监测工作流。

按照下方说明,在 Azure Logic Apps 中构建一个由 Bright Data 的 SERP API 驱动的自动化网页搜索工作流吧!

前置条件

为了跟随本教程的这一部分,请确保你已具备:

- 一个 Microsoft 账号。

- 一个 Azure 订阅(即使是免费试用也足够)。

- 一个 Bright Data 账号,并且拥有已启用的 SERP API zone 与 API key(具备 Admin 权限)。

请按照 Bright Data 官方文档设置你的 SERP API zone 并获取 API key。请将 API key 与 zone 名称安全保存,因为你很快就会用到它们。

步骤 1:创建一个新的 Logic App

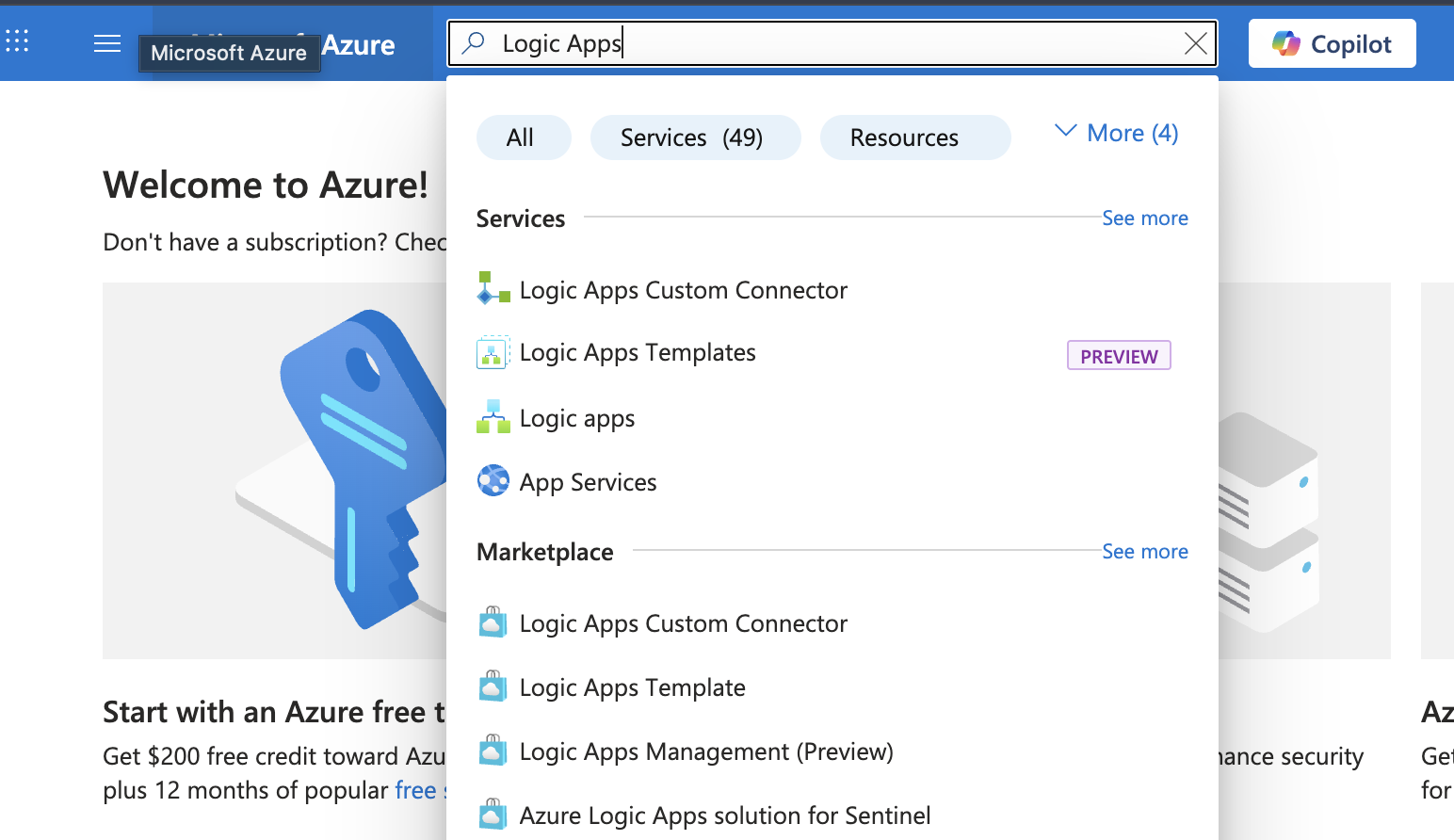

登录你的 Azure 账号,在 Azure Portal 顶部的搜索框中搜索 “Logic Apps”:

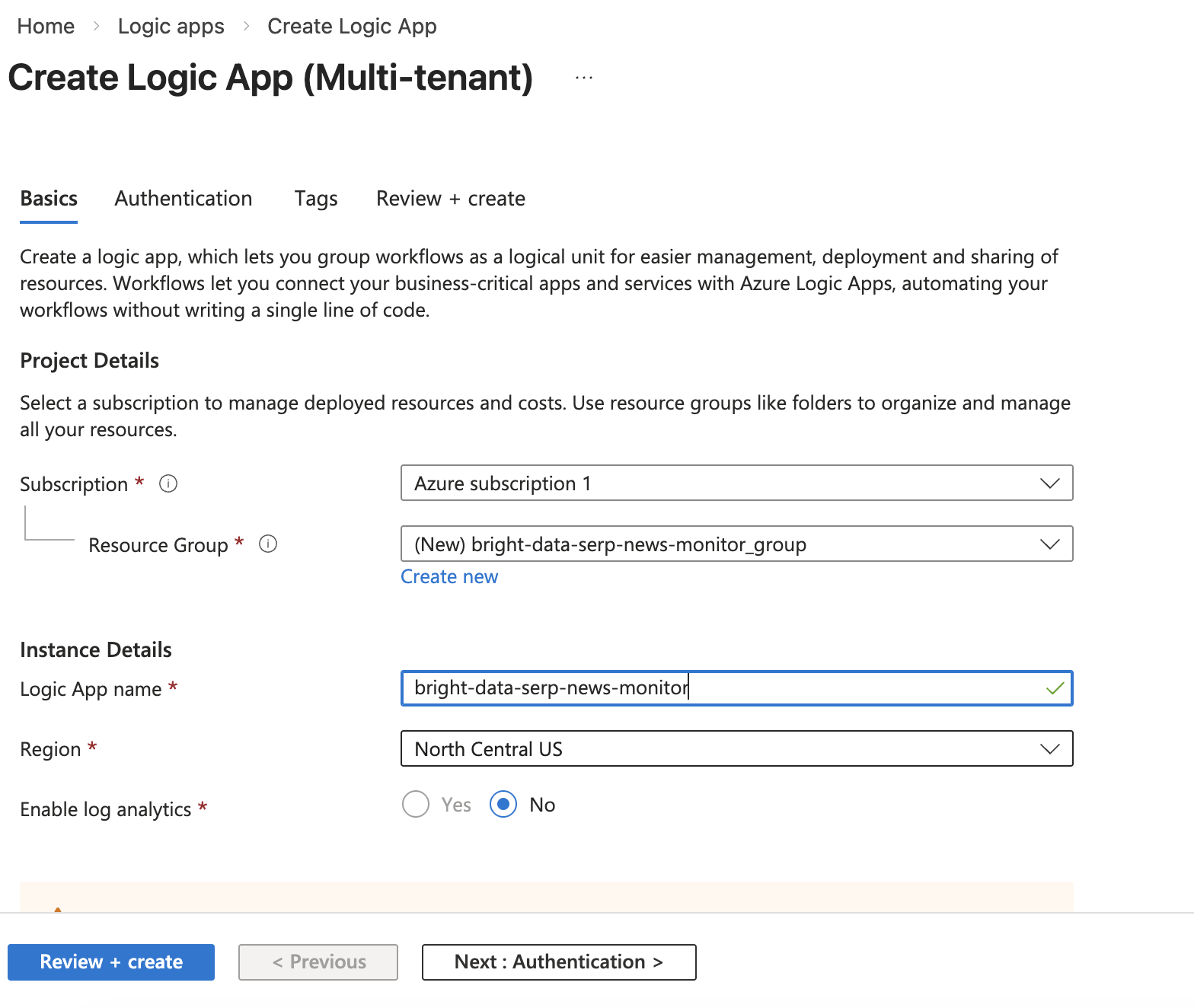

在 Logic Apps 管理页面,点击 Create 按钮并填写创建表单:

- 在计划类型中选择 Consumption:(按执行计费,适合本教程)。

- 选择你的 Azure 订阅。

- 选择现有资源组或创建一个新的资源组。

- 取一个描述性的名称,例如

bright-data-serp-news-monitor。 - 选择一个离你更近的区域。

点击 Review + Create,然后点击 Create 部署你的 Logic App。

等待部署完成。就绪后,点击 Go to resource 打开你新创建的 Logic App。

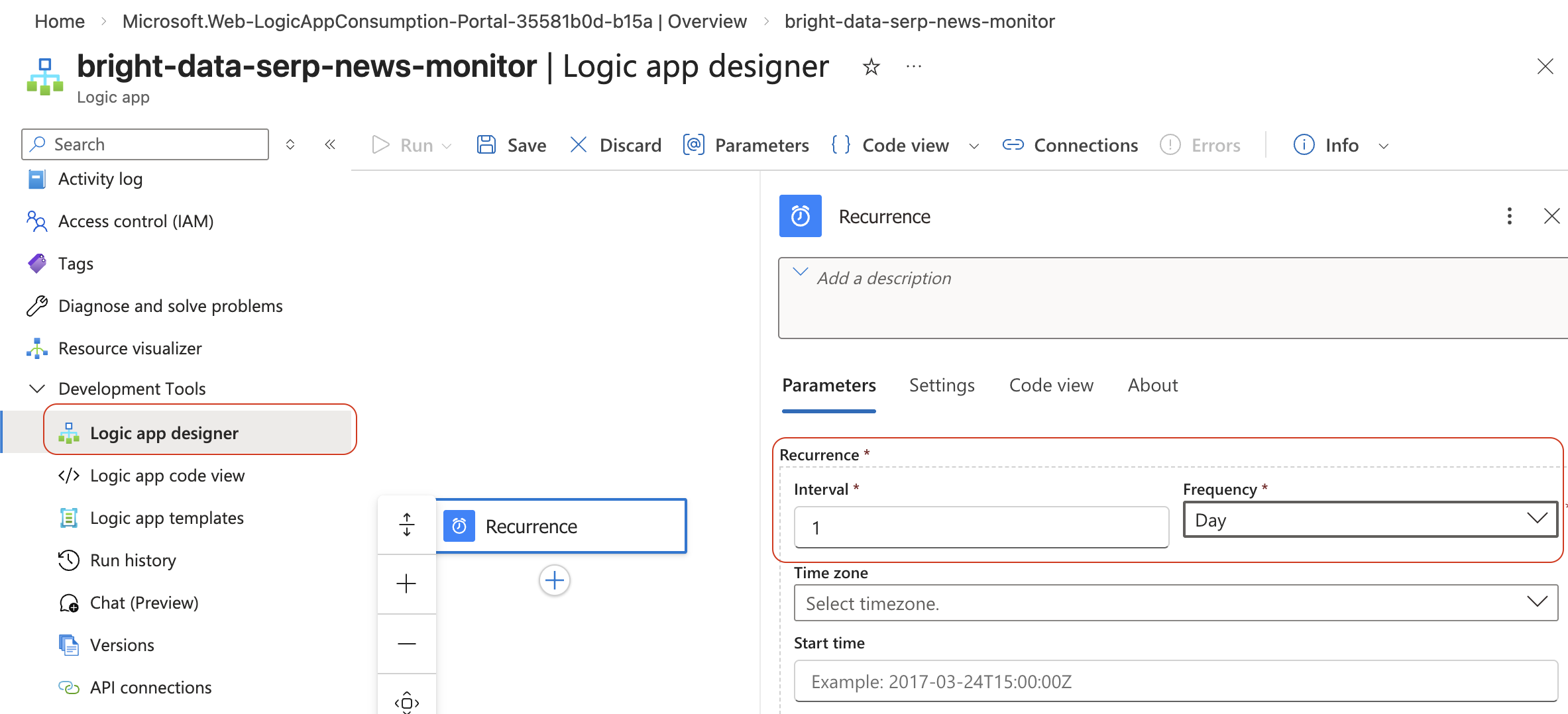

步骤 2:使用 Recurrence 触发器初始化工作流

部署完成后:

- 在 Development Tools 下打开设计器,选择 Logic App Designer。

- 选择一个 Trigger(每个 logic app 都必须以触发器开始)。

- 选择 Recurrence 触发器以按计划启动工作流,并按如下配置:

- Interval:

1 - Frequency:

Day

这表示工作流会每天自动运行一次。你可以按需调整频率,例如设置为每小时运行一次,以便更及时地监测。

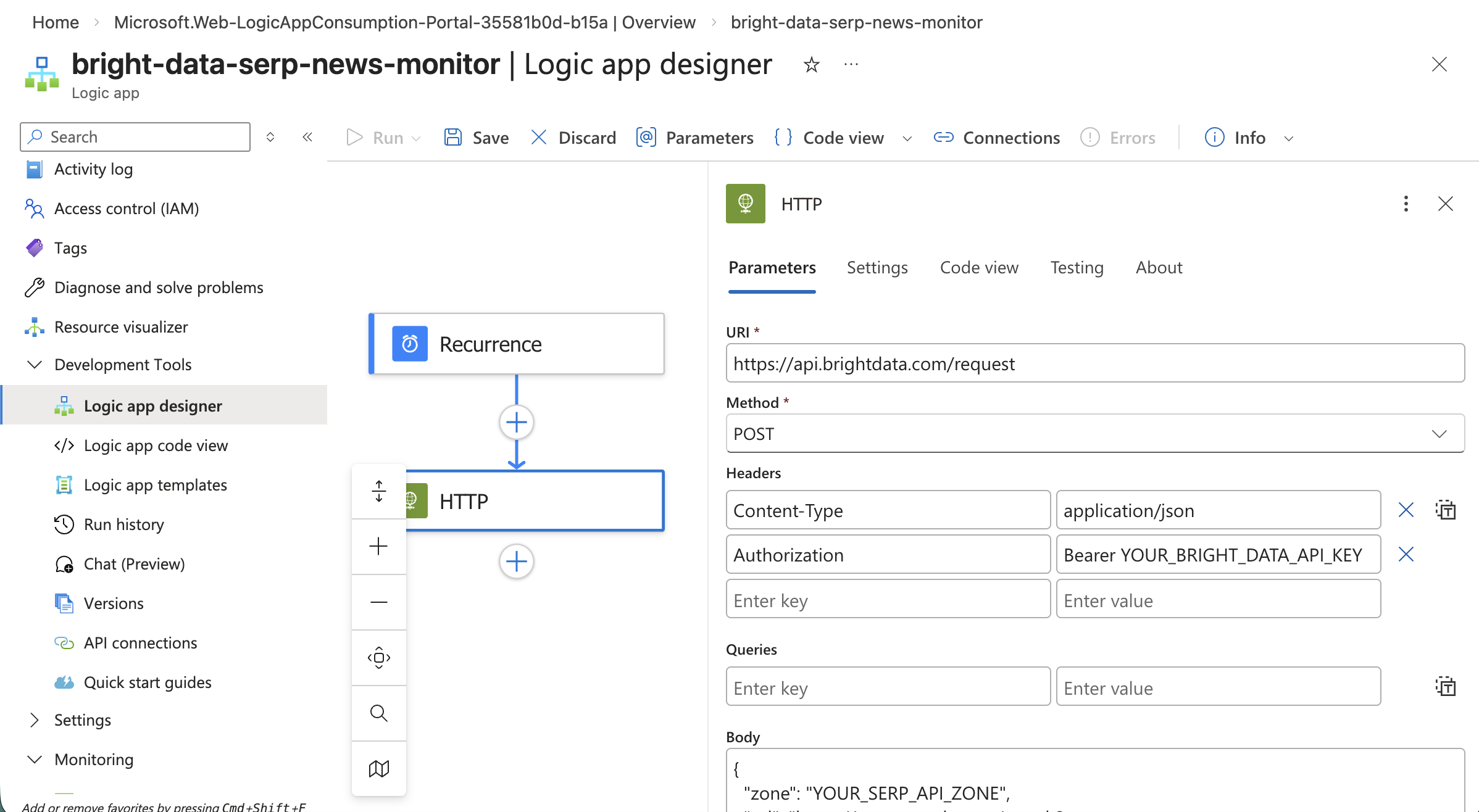

步骤 3:添加一个 HTTP 操作来调用 SERP API

接下来,添加用于调用 Bright Data SERP API 的操作。点击 +,选择 Add an action,然后在操作列表中搜索 HTTP。选择 HTTP 操作(内置的那个,而不是 connector)。

使用以下设置配置 HTTP 操作:

- Method:

POST - URI:

https://api.brightdata.com/request - Headers:

Content-Type:application/json.Authorization:Bearer YOUR_BRIGHT_DATA_API_KEY- Body:

{

"zone": "YOUR_SERP_API_ZONE",

"url": "https://www.google.com/search?q=stock+market+news&tbm=nws&hl=en&gl=us",

"format": "raw",

"data_format": "markdown"

}

下面拆解一下这个请求的作用:

zone:你在 Bright Data 控制台中的 SERP API zone 名称。url:用于获取新闻结果的 Google 搜索 URL(tbm=nws表示 Google News)。你可以自定义q查询参数来监测任何你想要的主题。format:设置为"raw"以获取原始响应。data_format:设置为parsed_light将返回包含标题、URL 与描述的自然结果 JSON 数组。

提示:如果你希望以更清晰的格式接收 SERP 内容,也可以使用

"data_format": "markdown"。这将返回结构化的 Markdown 格式,非常适合人工阅读与 LLM 处理。查看 SERP API 文档了解所有可用选项。安全提示:在生产工作流中,避免在 HTTP 操作里直接硬编码 API key。建议将其存储在 Azure Key Vault 中,并在 Logic App 里通过 Key Vault connector 引用。这样可以确保你的凭证被加密并安全管理。

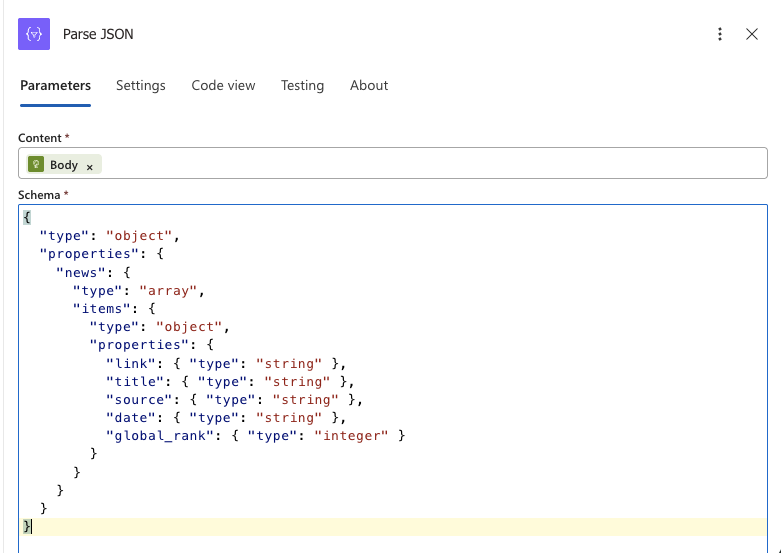

步骤 4:解析 SERP API 响应

当 HTTP 操作获取到 SERP 数据后,你需要解析响应,以便在后续步骤中使用它。

如果你使用了 data_format: "markdown",响应体将是一段 Markdown 字符串。你可以直接把它放进邮件正文,或保存到文件中。

不过,如果你更偏好结构化数据,可以将 SERP API 请求改为使用 data_format: "parsed_light"。在这种情况下,在 HTTP 步骤后添加一个 Parse JSON 操作:

- 点击 +,选择 Add an action 并搜索 Parse JSON。

- 在 Content 字段中,选择 HTTP 操作输出的 Body。

- 在 Schema 字段中,粘贴与 SERP API 响应结构对应的 JSON schema。你可以通过对 SERP API 运行一次测试请求,然后使用 Use sample payload to generate schema 来生成该 schema。

下面是一个针对 parsed_light 格式的示例 schema:

{

"type": "object",

"properties": {

"news": {

"type": "array",

"items": {

"type": "object",

"properties": {

"link": { "type": "string" },

"title": { "type": "string" },

"source": { "type": "string" },

"date": { "type": "string" },

"global_rank": { "type": "integer" }

}

}

}

}

}

这样一来,各个搜索结果字段(例如 title、link 与 description)就会作为动态内容在后续操作中可用。

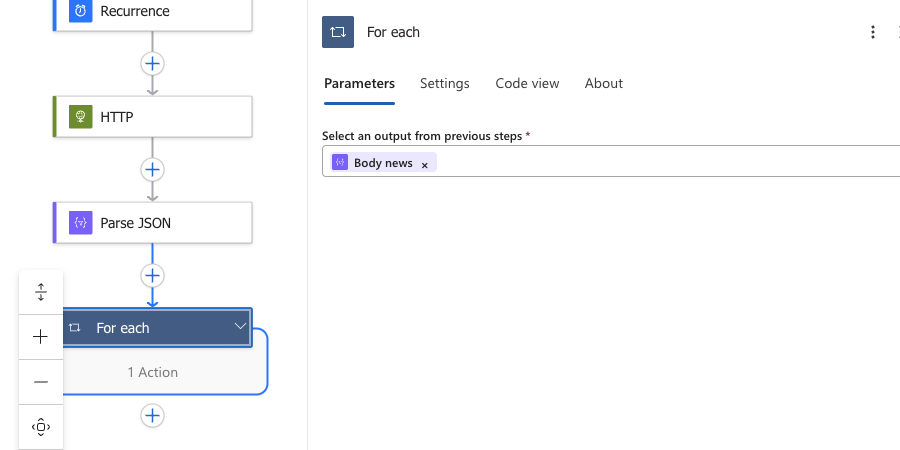

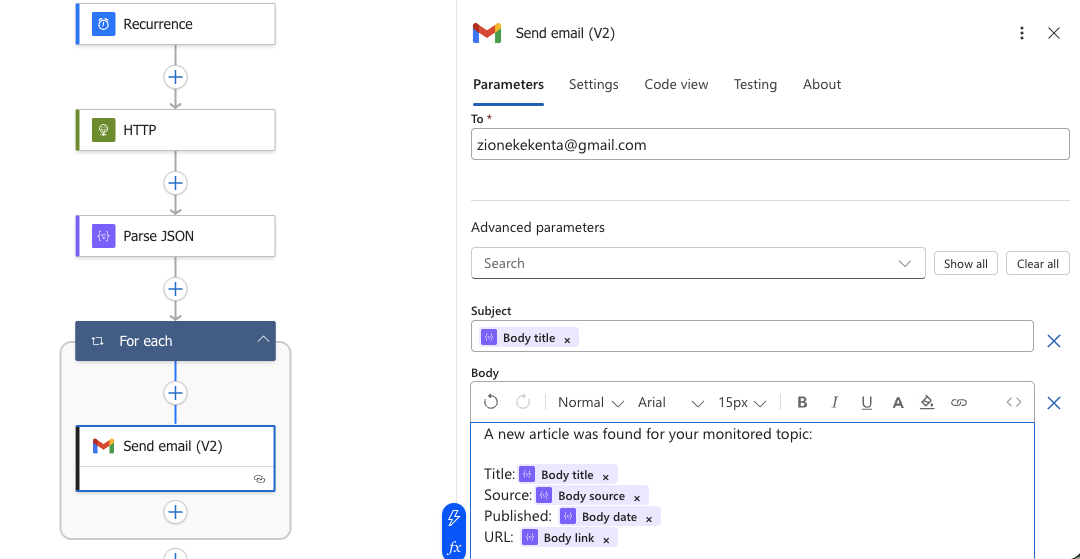

步骤 5:遍历结果并发送邮件告警

现在你已经解析了 SERP 结果,就可以遍历每一篇新闻文章并发送邮件告警。

- 点击 +,选择 Add an action,然后添加一个 For each 控制操作。

- 在 Select an output from previous steps 字段中,选择 Parse JSON 输出中的

news数组。

- 在 For each loop 内,点击 Add an action,搜索 Gmail 并连接。

- 配置邮件操作:

- To:你的邮箱地址(或分发列表)。

- Subject:点击 Subject 字段,然后点击 Add dynamic content(闪电图标)。在动态内容面板中选择

title。 - Body:通过将静态文本与动态内容 token 混合来构建正文。点击 Body 字段,输入静态标签文本,然后使用 Add dynamic content 面板插入解析 JSON 中的各个字段。

步骤 6:保存并测试工作流

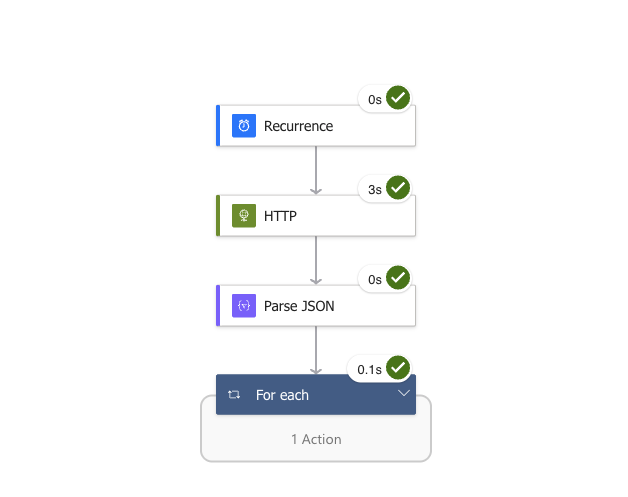

当所有步骤都配置完毕后,你的 Logic App 工作流在设计器中应当如下所示(从上到下):

- Recurrence → 每日触发

- HTTP → 调用 Bright Data SERP API

- Parse JSON → 将响应结构化

- For each → 遍历每条新闻结果

- Send an email → 为每篇文章发送告警

点击设计器顶部的 Save 保存你的工作流。

若要立即测试而不等待下一次计划运行,点击 Run Trigger 按钮并选择 Run。工作流会实时执行。

步骤 7:检查结果

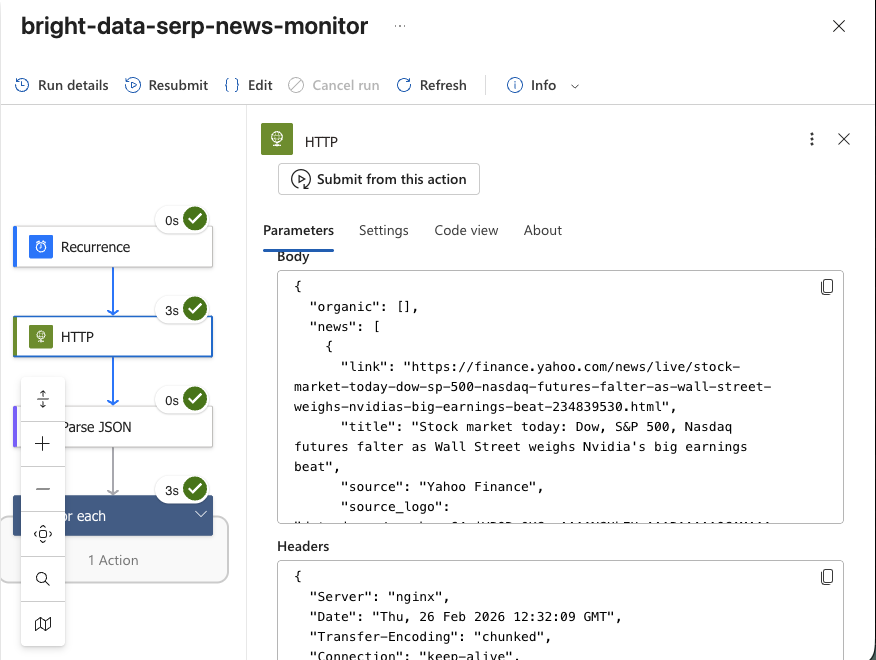

工作流运行后,进入 “Runs history” 区域(在 Logic App 的概览页面可见),点击最近一次运行以进行检查。

你会看到每一步的可视化展示,其中包括:

- Recurrence 触发器(成功)。

- HTTP 操作(包含来自 Bright Data SERP API 的完整请求与响应)。

- Parse JSON 操作(包含结构化输出)。

- For each 循环(包含每次迭代与已发送的邮件)。

展开 HTTP 操作以验证是否成功获取 SERP 数据。响应体会包含你所选主题的 Google News SERP 的 Markdown 或 JSON 内容。

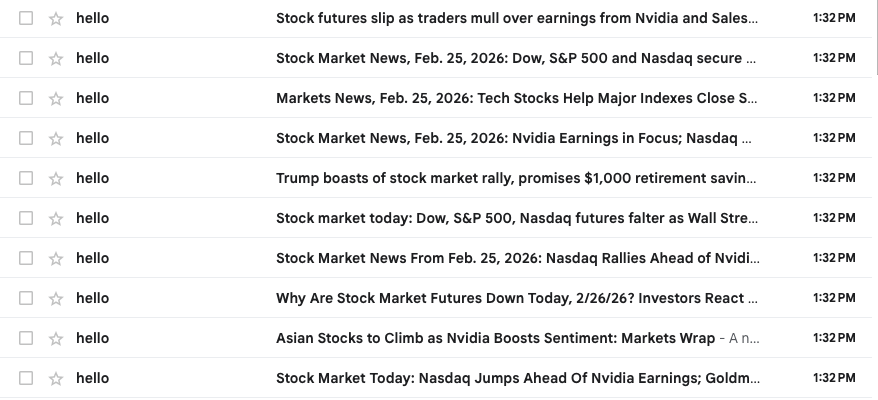

检查你的收件箱,你应该会看到针对 “stock market news”(或你配置的任意主题)的搜索结果中出现的每篇新闻文章分别发送的一封邮件。

SERP API 返回了来自 Google 的最新实时结果,而你的 Logic App 自动将它们投递到收件箱:无需代码、无需服务器、无需抓取基础设施。由于反爬措施与限流器的存在,手动抓取 Google 搜索结果出了名地困难。使用 Google Search API 后,你可以以面向 AI 的 Markdown 或结构化 JSON 格式,从不同地区稳定获取 Google(或任何其他支持的搜索引擎)的结果,并且不受扩展性限制。

更进一步

这个示例展示了一个简单用例,但你可以从很多方向扩展你的 Logic App:

- 将 SERP 数据转发到同一 Logic App 中的 Azure OpenAI 操作,对新闻文章进行摘要或评估,类似我们在 Azure AI Foundry 教程中构建的内容。

- 使用 Azure SQL 或 Cosmos DB connector 记录 SERP 结果,便于历史分析。

- 将邮件步骤替换为 Slack 或 MS Teams connector,以实时通知团队。

- 添加并行 HTTP 操作,同时查询 Bright Data 的 Bing 搜索引擎端点或其他搜索引擎,然后合并结果。

- 集成 Bright Data 的 Web Unlocker,从 SERP API 返回的 URL 抓取完整文章内容,从而在同一工作流中实现更深入的分析。

- 使用 SERP 数据驱动 agentic RAG 工作流,或将结果输入到 CrewAI、LangChain 等框架中。

可能性几乎是无限的!

结论

在这篇博客文章中,你学习了如何使用 Bright Data 的 SERP API 从 Google 获取最新搜索结果,并将其集成到 Azure Logic Apps 的自动化工作流中。

这里展示的工作流非常适合想要构建无代码新闻监测与告警系统的人,它可以自动将相关内容直接发送到你的收件箱。不同于Azure AI Foundry 的方案(更适合以 AI 为先的提示词工程与 RAG 工作流),当你需要事件驱动自动化、多系统集成与零代码工作流编排时,Azure Logic Apps 表现更出色。

若要创建更高级的自动化工作流,请探索 Bright Data 的完整搜索与提取工具套件,用于检索、校验与转换实时 Web 数据。

立即免费注册 Bright Data 账号,开始体验我们面向 AI 的 Web 数据解决方案!