在本文中,你将了解:

- 什么是 LM Studio 以及它提供的功能。

- 为什么使用 Bright Data 的 Web MCP 工具扩展其本地 AI 模型是明智之选。

- 如何在 LM Studio 中使用 Web MCP,为你的 AI 提升更强大的能力。

我们开始吧!

什么是 LM Studio?

LM Studio 是一款桌面应用程序,可让你在本机离线运行大语言模型(LLM)。该应用提供友好的界面,帮助你发现、下载并与多个开源 LLM 交互,全程无需任何技术背景。

LM Studio 的主要功能包括:

- 跨平台体验:适用于 Windows、macOS 和 Linux。

- 本地私密处理:你的数据保留在电脑本地,确保隐私与安全。

- 离线运行:在无网络环境下也能运行模型,保证工作不中断。

- 简单安装:简化 LLM 的安装与运行,让初学者与专业人士都能轻松使用先进 AI。

- 用户友好界面:直观的图形界面,内置聊天功能,便于实验 LLM。

- 模型种类丰富:支持多种开源 LLM 格式,如 GGUF,可轻松发现并下载。

- 本地推理服务器:托管一个模拟 OpenAI API 的本地 HTTP 服务器,便于将本地 LLM 集成到其他应用中。

- 可自定义:可调整温度、上下文长度等模型参数。

- 命令行集成:可通过

lms直接从命令行连接到你的 LM Studio 实例。 - 可扩展性:可通过 MCP 服务器的插件与工具扩展本地 AI 模型。

为什么要将 Bright Data 的 Web MCP 连接到 LM Studio

从 0.3.17 版本开始,LM Studio 可以充当 MCP 主机。这意味着你可以将 MCP 服务器连接到桌面应用,使其工具可供你的 AI 模型使用。

LM Studio 同时支持本地与远程 MCP 服务器。但基于其“本地优先”的理念,连接本地 MCP 服务器最为合理。

一个很好的例子是 Web MCP,这是 Bright Data 的 Web MCP 服务器,既提供开源软件包,也提供远程服务器。这能让 AI 模型获取最新的网页数据,并像人类一样与网页交互,从而克服其大多数内置限制。

更具体地说,Web MCP 暴露了60 多种开箱即用的 AI 工具,全部由 Bright Data 的网页交互与数据采集基础设施驱动。

即使在免费套餐中,你也能使用两个非常实用的工具:

| 工具 | 描述 |

|---|---|

search_engine |

以 JSON 或 Markdown 形式获取来自 Google、Bing 或 Yandex 的搜索结果。 |

scrape_as_markdown |

将任意网页抓取为干净的 Markdown 格式,能够绕过机器人检测与验证码。 |

除了这两个以外,Web MCP 还提供云浏览器交互工具,以及覆盖 YouTube、Amazon、LinkedIn、TikTok、Google 地图等平台的数十种结构化数据提要工具。

来看看 Web MCP 在 LM Studio 中的实际效果!

如何在 LM Studio 中将 Bright Data 的 Web MCP 工具用于本地 AI

在本节分步教程中,你将学习如何将 LM Studio 连接到本地的 Bright Data Web MCP 实例。该设置可在你的电脑上直接带来“超充”的 AI 体验。

具体来说,你的 AI 模型将使用 MCP 服务器提供的工具,实时获取 Google 地图(Google Maps)的评论以进行反馈分析。这只是该集成支持的众多场景之一。

按照以下说明开始吧!

先决条件

要完成本教程,你需要:

- 本地安装 LM Studio v0.3.17 或更高版本。

- 一个具有有效 API Key 的 Bright Data 账户。

无需着急进行任何设置,接下来的步骤会逐步引导你完成。

步骤一:安装 LM Studio

下载适用于你操作系统的 LM Studio 安装程序并在本地安装。

请确保使用 0.3.17 或更高版本的 LM Studio,因为 MCP 客户端功能是在该版本中引入的。如果你已经安装了 LM Studio 并配置了本地 LLM,请更新到最新版本。然后你可以直接跳到步骤三。

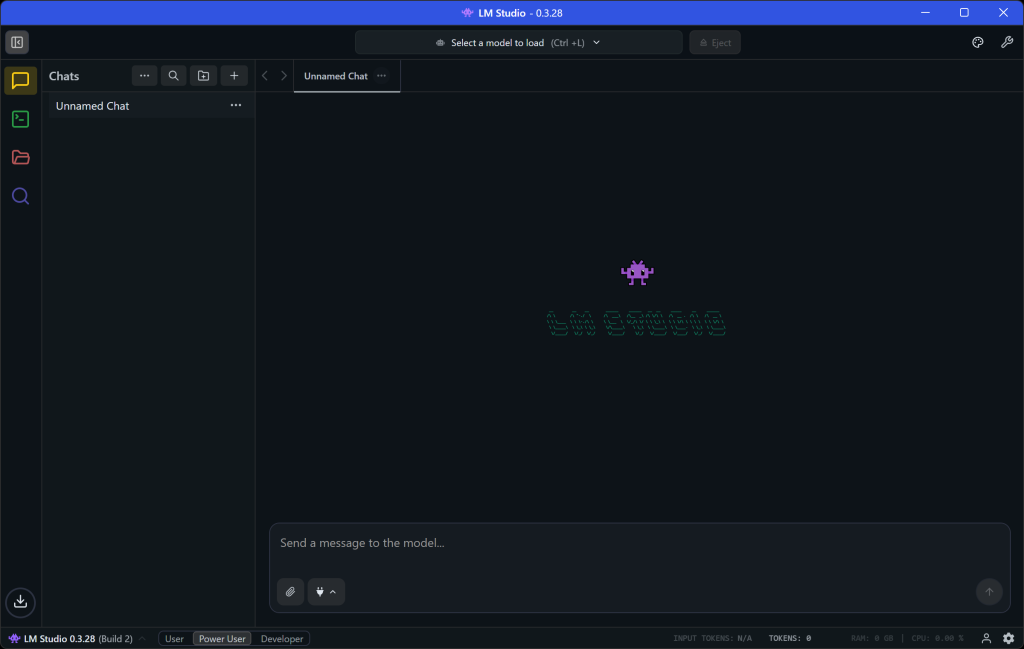

否则,请打开 LM Studio,完成(或跳过)初始设置向导,你将看到如下界面:

很好!LM Studio 现已安装就绪。

步骤二:下载一个 LLM 模型

LM Studio 需要本地 AI 模型才能工作。幸运的是,它内置了模型下载器,可轻松从 Hugging Face 获取任意受支持的模型。

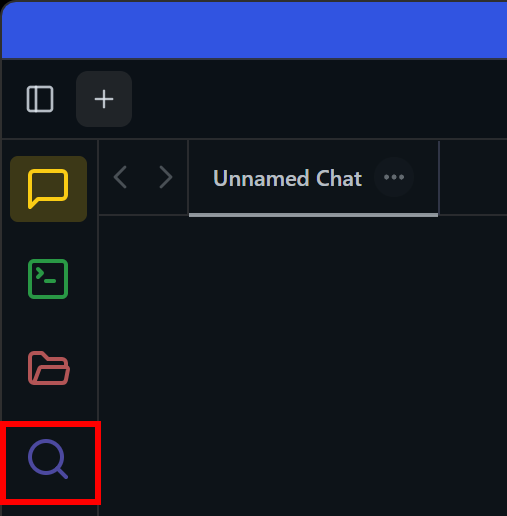

要下载模型,先点击左侧边栏的“Search”图标:

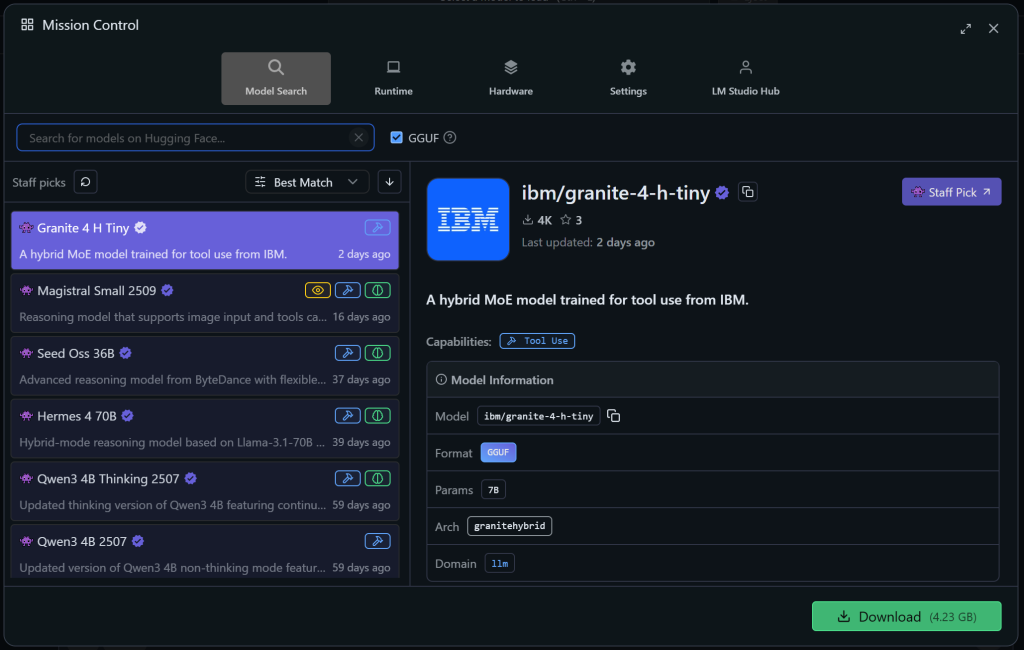

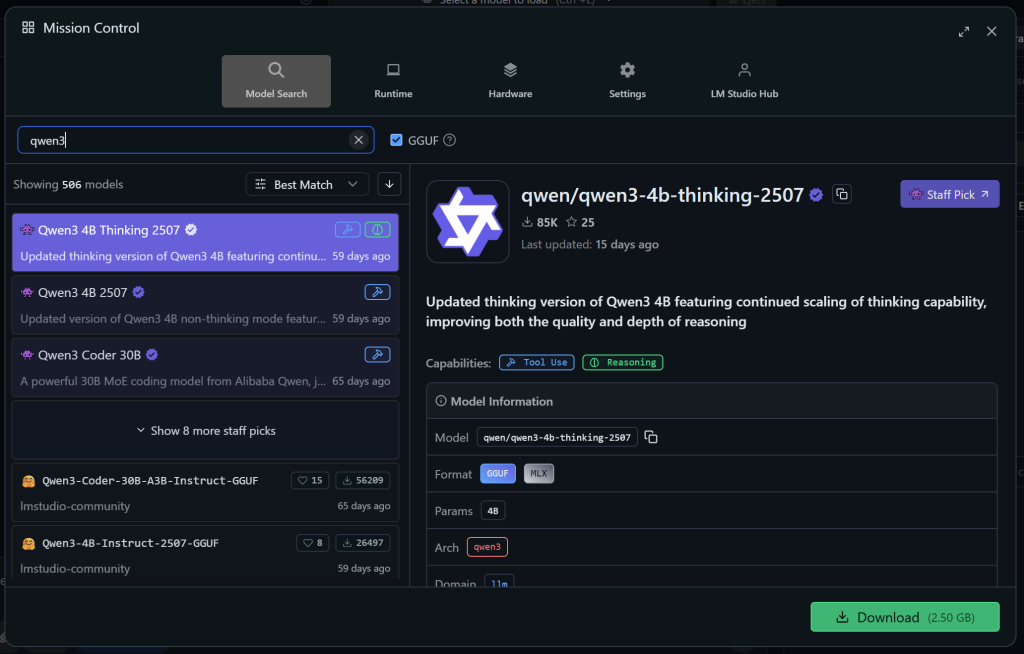

这会打开如下弹窗。确保位于“Model Search”选项卡:

在此处搜索模型(如 llama、gemma、lmstudio 等),选中后点击“Download”在本地下载。

本文示例将使用 Qwen3 4B Thinking 2507:

这是一个支持工具调用的强大模型(注意“Capabilities”部分的“Tool Use”标签)。请记住,Qwen3 在网页数据抓取方面表现出色。

注意:任何支持工具使用的其他模型也可以,因此按你的偏好选择即可。

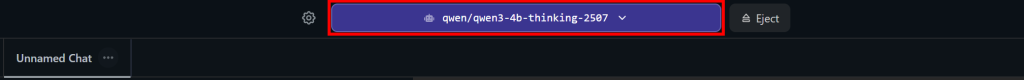

下载完成后,在应用中将其设为当前 AI 模型:

很好!LM Studio 现在已完全可用。接下来集成 Web MCP。

步骤三:本地测试 Bright Data 的 Web MCP

在 LM Studio 中配置连接 Bright Data Web MCP 之前,你需要先确认你的电脑确实能运行该服务器。

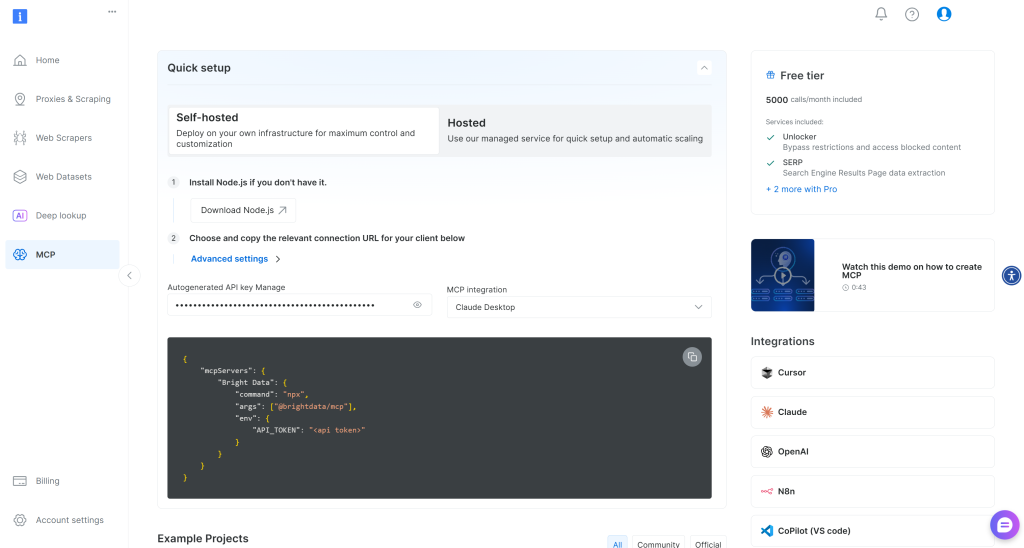

首先创建一个 Bright Data 账户。如果你已有账户,直接登录即可。若需快速设置,请参考你账户中的“MCP”部分说明:

如需更多指导,请继续查看以下说明。

先获取你的 Bright Data API Key。请妥善保存,稍后会用到。为简化 Web MCP 的集成流程,下面假设你的 API Key 具备 Admin(管理员)权限。

现在,通过以下命令将 Web MCP 全局安装到你的机器上:

npm install -g @brightdata/mcp通过运行它来检查 MCP 服务器是否正常工作:

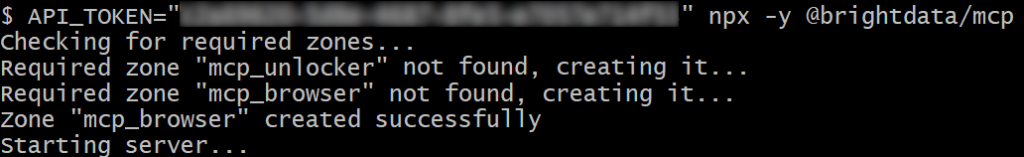

API_TOKEN="<YOUR_BRIGHT_DATA_API>" npx -y @brightdata/mcp或者在 PowerShell 中:

$Env:API_TOKEN="<YOUR_BRIGHT_DATA_API>"; npx -y @brightdata/mcp将 <YOUR_BRIGHT_DATA_API> 替换为你的 Bright Data API Token。上述命令会设置所需的 API_TOKEN 环境变量,并通过运行 @brightdata/mcp 包在本地启动 Web MCP。

如果成功,你将看到类似如下的输出:

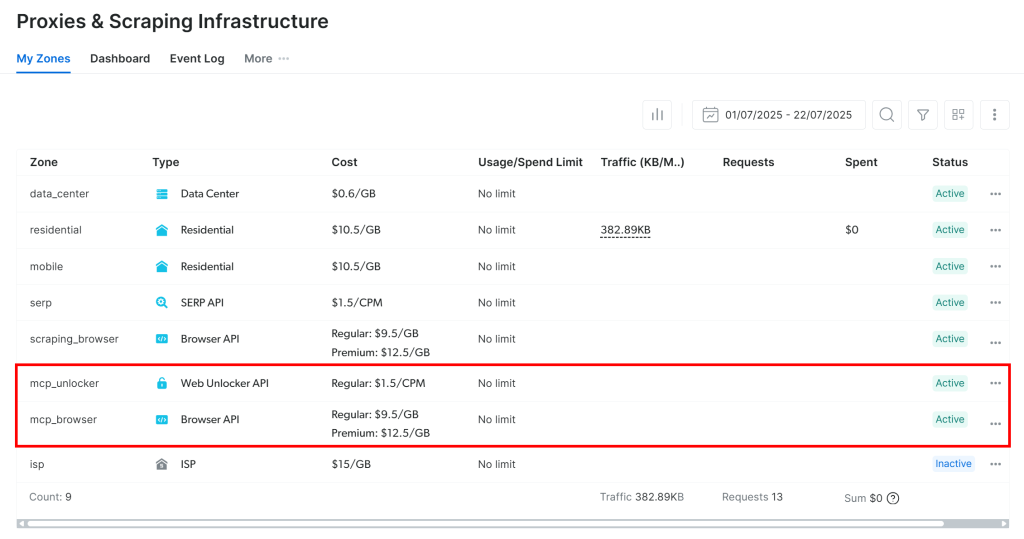

这是因为在首次启动时,Web MCP 会自动在你的 Bright Data 账户中创建两个默认的 Zone(区域):

mcp_unlocker:用于 Web Unlocker。mcp_browser:用于 Browser API。

Web MCP 依赖这两个 Bright Data 产品来驱动其 60+ 个工具。

如果想验证这些 Zone 是否已创建,请前往 Bright Data 控制台中的“Proxies & Scraping Infrastructure”页面。你应能在表格中看到这两个 Zone:

注意:如果你的 API Token 不具备 Admin 权限,这两个 Zone 将不会被创建。此时需要你手动创建,并通过环境变量进行设置,具体方法见 GitHub。

在Web MCP 免费套餐中,MCP 服务器只会暴露 search_engine 和 scrape_as_markdown 工具(及它们的批量版本)。要解锁其他工具,需要启用 Pro 模式 **by setting the PRO_MODE="true" environment variable:

API_TOKEN="<YOUR_BRIGHT_DATA_API>" PRO_MODE="true" npx -y @brightdata/mcp或在 Windows 上:

$Env:API_TOKEN="<YOUR_BRIGHT_DATA_API>"; $Env:PRO_MODE="true"; npx -y @brightdata/mcpPro 模式可解锁全部 60+ 工具,但不包含在免费套餐内,因此会产生额外费用。

搞定!你刚刚验证了 Web MCP 服务器已能在你的机器上运行。结束 MCP 进程,我们即将配置 LM Studio 与其连接。

步骤四:配置 Web MCP 连接

你可以通过编辑 应用的 mcp.json 配置文件来添加 MCP 连接。

该文件的语法与 Cursor 中相同。

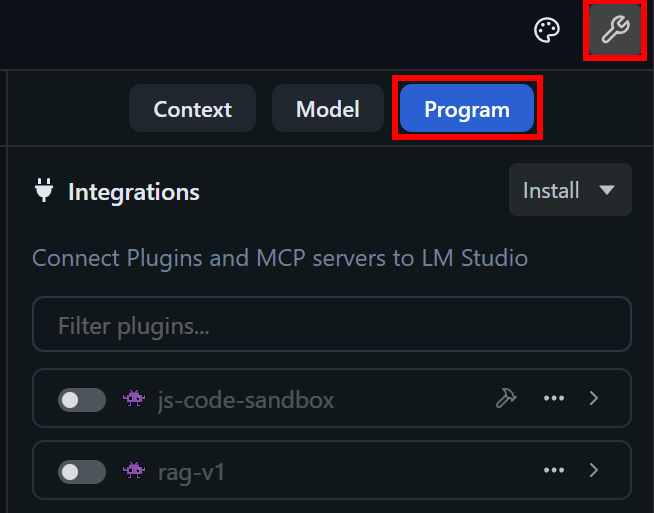

要访问 mcp.json,点击“Show Settings”图标,并在右侧边栏切换到“Program”标签页:

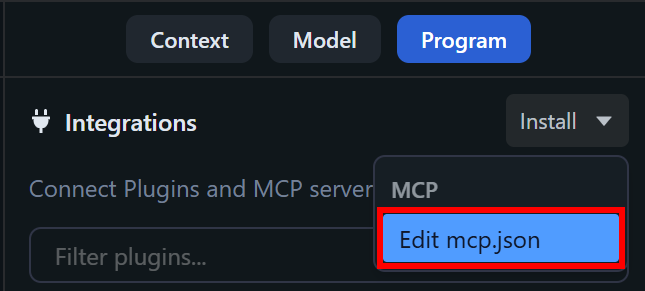

接着打开“Install”下拉菜单,选择“Edit mcp.json”选项:

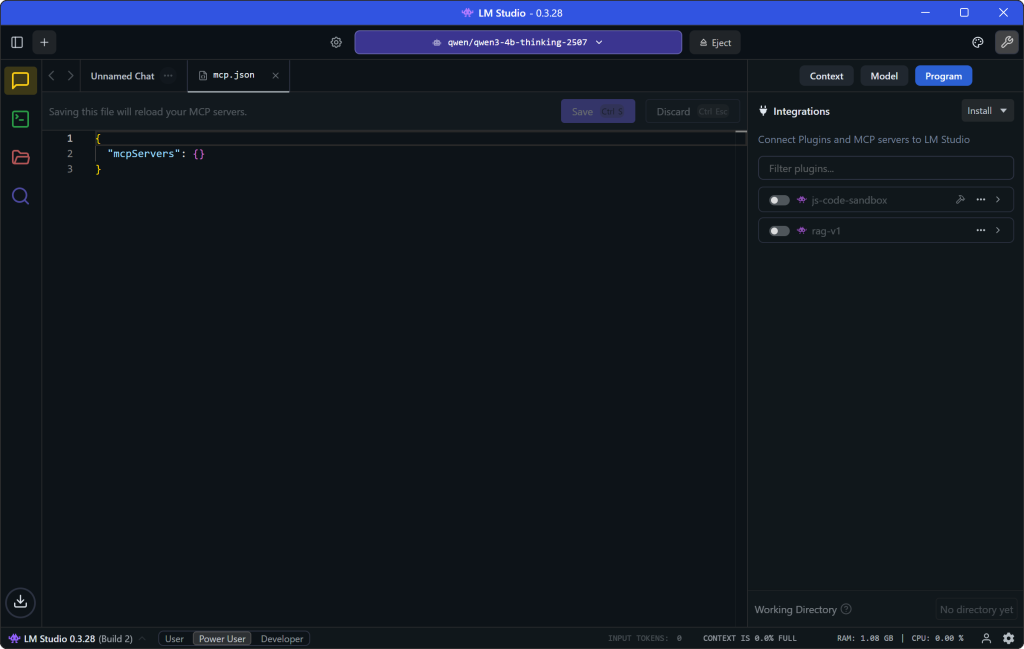

此时你会在 LM Studio 中直接看到打开的 mcp.json 文件:

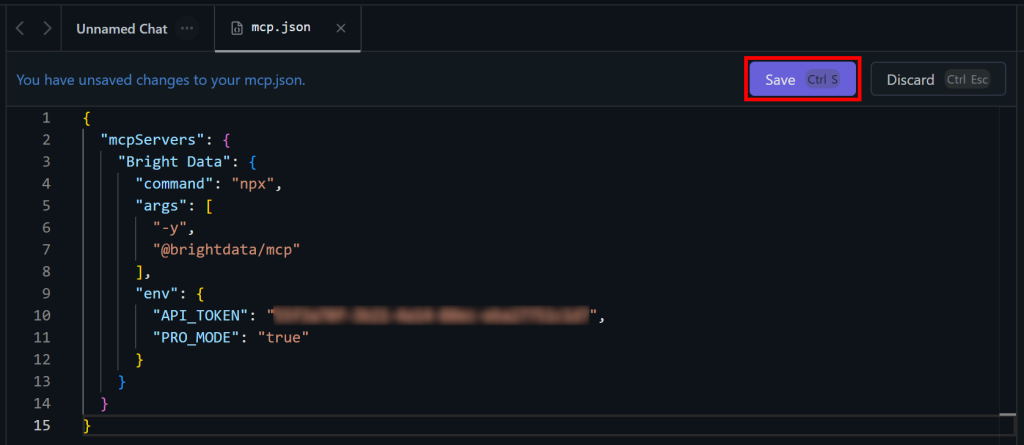

在该文件中粘贴以下 JSON 配置:

{

"mcpServers": {

"Bright Data": {

"command": "npx",

"args": ["-y", "@brightdata/mcp"],

"env": {

"API_TOKEN": "<YOUR_BRIGHT_DATA_API_KEY>",

"PRO_MODE": "true"

}

}

}

}该配置与前面测试的 npx 命令一致,使用环境变量作为凭据与设置:

API_TOKEN为必填。将其设置为你之前获取的 Bright Data API Key。PRO_MODE为可选,如不想启用 Pro 模式可删除。

完成后,点击“Save”以应用 Web MCP 集成:

很好!你现在可以关闭 mcp.json 标签页并返回聊天标签页。

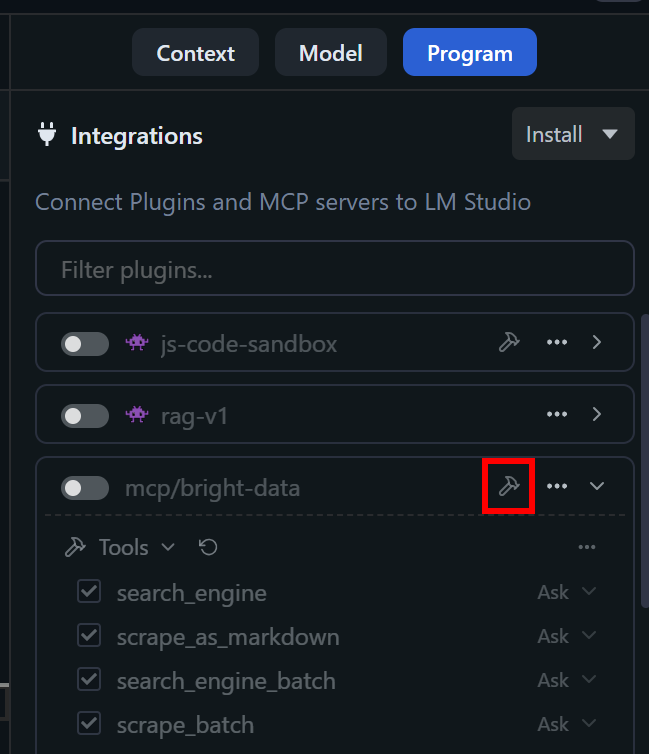

步骤五:验证 Web MCP 工具是否可用

LM Studio 现在可以使用配置的 npx 命令在本地启动 Web MCP 服务器,并访问其中的工具。

具体来说,在“Program”标签页中,你应能看到名为 mcp/bright-data 的新插件。点击“View plugin’s tools”按钮,验证你是否可以访问所有 Web MCP 工具:

如果未启用 Pro 模式(默认行为),你将仅看到 search_engine 和 scraped_as_markdown 工具(及其 fetch 版本)。如果启用了 Pro 模式(设置了 PRO_MODE: "true"),你应能看到全部 60+ 可用工具。

这表明与 Bright Data Web MCP 服务器在 LM Studio 中的集成已成功!

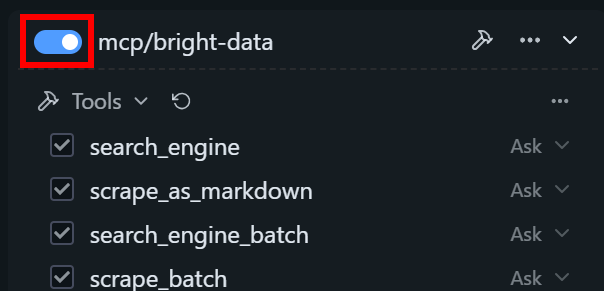

然后,切换开关以启用 mcp/bright-data 插件:

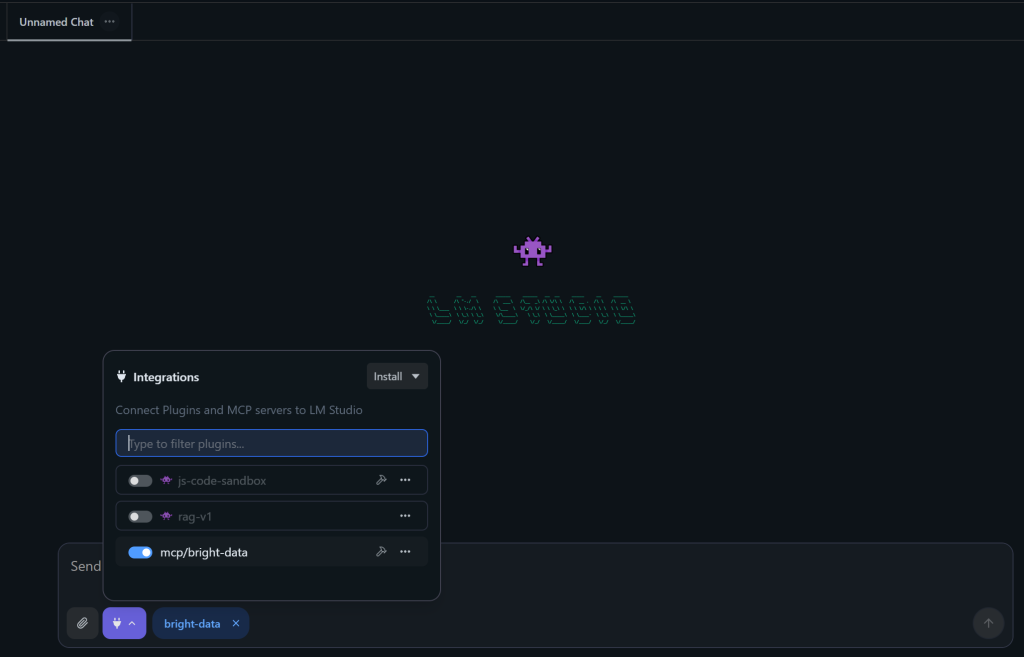

在聊天标签页中,你会看到“bright-data”已列为一个活动插件:

太棒了!你的本地 AI 模型现已具备多个实用的 Web MCP 工具访问能力。

步骤六:为工具执行准备 AI 模型

如果你此时尝试运行任意提示,可能会出现如下错误:

“Trying to keep the first XXXX tokens when context the overflows. However, the model is loaded with context length of only 4096 tokens, which is not enough. Try to load the model with a larger context length, or provide a shorter input.”

这是因为默认情况下,LM Studio 会将新下载模型的上下文长度设置为 4096 token。这通常不足以执行工具!

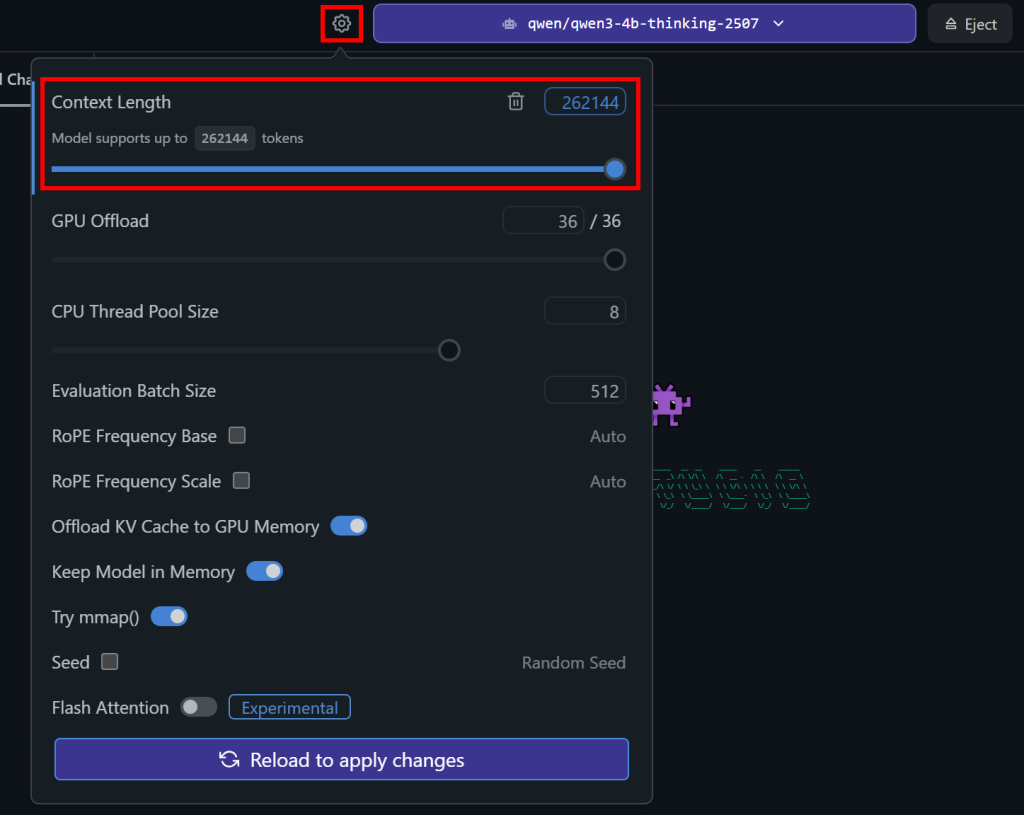

要解决此问题,点击模型选择下拉框左侧的齿轮图标,然后将“Context Length(上下文长度)”增大到更合适的值:

随后点击“Reload to apply changes”按钮保存并重载。模型将以更新的配置重新加载。

完美!本地 LLM 现在可以执行工具了。

步骤七:测试你的“超充”本地 AI 模型

LM Studio 中的本地 AI 模型如今可以使用 Web MCP 提供的全部网页数据获取与交互能力。为验证这一点,尝试使用如下提示进行测试:

I am the owner of the following shop in Manhattan:

"https://www.google.com/maps/place/The+$10+Shop/@40.7417447,-73.9932183,17z/data=!3m1!4b1!4m6!3m5!1s0x89c259067c12c915:0x71f11ffbb8a2223c!8m2!3d40.7417447!4d-73.9932183!16s%2Fg%2F11tt34hz63"

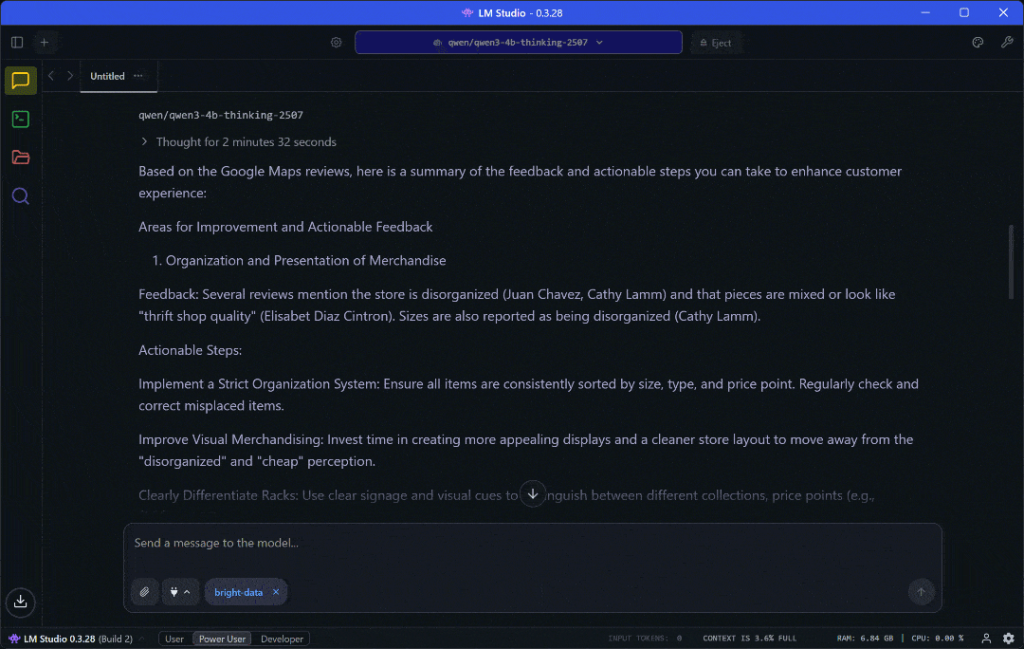

Please retrieve the Google Maps reviews for this location and provide actionable feedback on areas I can improve to enhance customer experience.该提示假设你是 Google 地图中某家店铺的店主,并希望 AI 从评论中生成可执行的洞察。通常,这需要大量人工工作,如阅读每条评论、理解内容并提取独特见解。

得益于在 LM Studio 中集成 Web MCP,AI 模型可以自动从 Google 地图获取评论,并将这些数据输入模型以生成可执行反馈。

执行该提示后,你应能看到如下过程:

其过程为:

- 本地模型处理提示,思考任务并生成计划。

- 调用 Web MCP 的

web_data_google_maps_reviews工具。该工具的描述是“快速读取结构化的 Google 地图评论数据。需要一个有效的 Google 地图 URL。该工具可能使用缓存查找,因此比抓取更可靠。”这正是达成目标的最佳工具! - 本地模型执行工具,获取评论数据并进行处理。

- 随后对数据进行分析,基于真实评论产出包含可执行洞察的报告。

最终将得到类似如下的报告:

哇!仅凭一个提示,你就能获得包含所有必要洞察的完整报告。

正如你在Google 地图源页面上所看到的,这份报告以即时抓取到的评论数据为依据。

如果你曾尝试过抓取 Google 地图,就会知道这件事因为需要用户交互与反爬机制而颇具挑战。仅靠 AI 模型自身显然难以胜任。这正是 Web MCP 服务器大显身手的地方!

尽情尝试不同的提示吧。借助 Bright Data Web MCP 提供的广泛工具,你可以应对许多其他用例。

Et voilà!你刚刚体验了 Bright Data 的 Web MCP 与 LM Studio 结合的强大威力。

总结

在本文中,你学习了如何利用 LM Studio 的 MCP 集成功能。尤其是,了解了如何本地通过 @brightdata/mcp 运行 Bright Data 的 Web MCP 工具,并将其连接到 LM Studio 中的本地 Qwen3 模型。

该集成为你的模型提供网页搜索、结构化数据提取、实时网页数据流、自动化网页交互等工具。若要构建更复杂的、以数据为核心的 AI 代理,请探索 Bright Data 的完整 AI 生态中提供的各类 AI 就绪产品与服务。

立即免费创建 Bright Data 账户,亲手体验我们的网页数据工具吧!